Ceph基础命令与集群基本管理 数据处理与存储支持服务详解

Ceph是一个开源的、统一的分布式存储系统,以其高扩展性、可靠性和自动化管理能力,在现代数据中心和云平台中扮演着数据处理与存储支持服务的核心角色。它提供了对象存储、块存储和文件系统三种接口,满足多样化的存储需求。本文将重点介绍Ceph的基础命令、集群的基本管理操作,以及其在数据处理和存储支持服务中的应用。

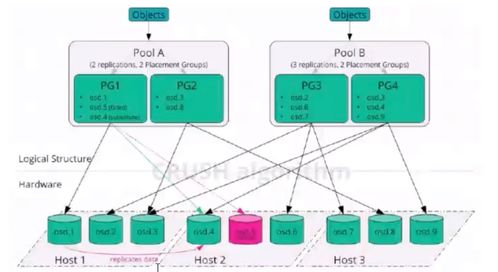

一、Ceph集群基本概念与架构

在深入命令之前,需理解Ceph的核心组件:

- Monitor (MON): 维护集群状态的主映射,如OSD Map、Monitor Map、PG Map等,确保集群一致性。

- Object Storage Daemon (OSD): 负责数据存储、复制、恢复和再平衡的核心守护进程。每个OSD对应一个物理或逻辑存储设备。

- Manager (MGR): 提供集群管理和监控功能,如Dashboard、性能指标收集等。

- Metadata Server (MDS): 仅在使用CephFS(文件系统)时需要,用于存储文件系统的元数据。

集群的健康状态通常由ceph -s或ceph status命令查看,它会显示集群的总体健康状况、存储空间使用情况以及各守护进程的状态。

二、Ceph基础命令

这些命令是日常管理和监控的基石。

- 集群健康与状态检查

ceph -s或ceph status: 查看集群摘要状态。

ceph health detail: 查看集群健康状态的详细信息,包括任何警告或错误。

ceph mon stat: 查看Monitor状态。

ceph osd stat: 查看OSD状态,包括总数、运行数等。

ceph df: 查看集群的详细存储使用情况(包括总容量、已用、可用空间)。

- OSD管理

ceph osd tree: 以树形结构显示OSD的分布和状态(如up/in, down/out)。

ceph osd dump: 显示OSD映射的详细信息。

ceph osd out <osd-id>: 将OSD移出集群(数据开始迁移)。

ceph osd in <osd-id>: 将OSD重新加入集群。

ceph osd crush reweight <osd-id> <weight>: 调整CRUSH权重以控制数据分布。

- Pool(存储池)管理

ceph osd pool ls或ceph osd lspools: 列出所有存储池。

ceph osd pool create <pool-name> <pg-num> [<pgp-num>]: 创建存储池,需指定PG(Placement Group)数量。

ceph osd pool set <pool-name> <key> <value>: 设置存储池参数,如副本数(size)、最小副本数(min_size)等。

ceph osd pool delete <pool-name> <pool-name> --yes-i-really-really-mean-it: 删除存储池(需二次确认)。

- 认证与密钥管理

ceph auth list: 列出所有客户端密钥和权限。

ceph auth get-or-create client.<client-name> mon 'allow r' osd 'allow rwx pool=<pool-name>': 创建并获取一个客户端密钥。

三、集群基本管理

- 启动与停止服务

- 通常使用系统服务管理命令,例如:

sudo systemctl start ceph-mon@<monitor-hostname>

sudo systemctl start ceph-osd@<osd-id>

sudo systemctl start ceph-mgr@<manager-hostname>

- 停止服务只需将

start替换为stop。

- 添加/移除OSD

- 添加:使用

ceph-deploy(传统部署)或ceph orch(使用Cephadm或Rook等编排器)工具,准备磁盘后将其加入CRUSH Map并启动OSD守护进程。

- 移除:首先将OSD状态设置为

out(ceph osd out <osd-id>),等待数据迁移完成后,再停止服务并销毁OSD。

- 数据平衡与PG调整

- 当OSD权重变化或PG数量不足/过多时,集群会自动进行数据再平衡。

- 可以使用

ceph osd pool set <pool-name> pg_num <new-pg-num>调整PG数量,但需谨慎操作。

- 监控与日志

- 使用

ceph log查看集群日志。

- 启用MGR Dashboard (

ceph mgr module enable dashboard) 可通过Web UI进行直观的监控和管理。

四、Ceph作为数据处理与存储支持服务

Ceph不仅仅是简单的存储后端,它通过以下方式提供强大的数据处理和存储支持:

- 统一存储平台:

- 对象存储 (RADOS Gateway/RGW): 通过S3和Swift兼容的API,为大数据分析、备份归档、Web应用提供海量非结构化数据存储。

- 块存储 (RBD): 为OpenStack、Kubernetes(通过CSI)等云平台提供高性能、支持快照和克隆的虚拟磁盘,是数据库、虚拟机等关键负载的理想选择。

- 文件系统 (CephFS): 提供符合POSIX标准的共享文件系统,适用于HPC、共享工作区等场景。

- 数据处理支持:

- 高并发与吞吐: 数据被条带化分散到多个OSD上,支持并行读写,非常适合大数据处理框架(如Hadoop、Spark)的存储需求。

- 数据可靠性: 通过多副本(Replication)或纠删码(Erasure Coding)技术保证数据高可用和持久性,无需额外RAID。

- 快照与克隆: RBD和CephFS支持快照和克隆,便于数据备份、版本控制和快速部署。

- 存储服务高级特性:

- 分层存储/Cache Tiering: 可将热数据缓存到高性能介质(如SSD),冷数据沉降到大容量HDD,优化成本与性能。

- 多站点复制: RGW支持跨地域集群的异步数据复制,实现灾难恢复。

- 与Kubernetes深度集成: 通过RBD和CephFS CSI驱动,动态地为容器化应用提供持久化存储卷。

###

掌握Ceph的基础命令和集群管理是有效运维该存储系统的前提。从ceph -s的快速健康检查,到OSD、Pool的精细化管理,再到利用其统一接口构建健壮的数据处理与存储支持服务,Ceph为现代IT基础设施提供了强大而灵活的存储解决方案。在实际生产环境中,建议结合监控告警系统(如Prometheus + Grafana)和自动化运维工具,以确保集群长期稳定、高效地运行。

如若转载,请注明出处:http://www.qjxmcdh.com/product/13.html

更新时间:2026-05-20 07:33:09